用户转发微博预测特征的相关知识介绍,用户是否支持他的微博和博客中的微博内容?...

用户转发微博预测特征的相关知识介绍

用户是持有自己的微博还是博客中的微博内容...首先,如果你发布文本内容,你将有权获得版权。其次,如果你发表了一篇以技术文本为主体的文章,而这篇文章描述的是一种公众不太了解的技术,那么尽管你失去了专利保护的权利,但你可以使这篇文章描述的相同或基本相同的专利无效。当然,你的出版日期应该在研究所

如果做微博热度预测需要用到哪些知识

你需要知道什么因素影响微博的流行。 基于微博用户的综合传播能力、微博评论总数、微博内容信息量、微博发布时间等因素,通过一组公式计算流行微博的热度值。 一般来说:从传播力的角度来看,微博是由@微博秘书转发的,这比转发更常见。每个微博下面都有一个“转发”按钮。单击后,将会设置一个提示框来填写一些转发原因。您也可以按提示框的转发按钮。如果没有违规,你可以上传数据进行反向旋转,投诉下载反向旋转表单,并邮寄到新浪法律部开封 挺好的,现在微博用户很多,尤其是新浪微博,在微博上投放广告无疑是网上推广和营销的主要方式。 同时,你可以随时使用topbox来监控你的广告效果,这样你就可以知道你的广告是否有效。 不,网络服务器代码通常只在用户访问时运行,没有人会做任何事情来访问它。 除非你让php一直在一个死循环中运行

用户是否支持他的微博和博客中的微博内容?...

用户是持有自己的微博还是博客中的微博内容...首先,如果你发布文本内容,你将有权获得版权。其次,如果你发表了一篇以技术文本为主体的文章,而这篇文章描述的是一种公众不太了解的技术,那么尽管你失去了专利保护的权利,但你可以使这篇文章描述的相同或基本相同的专利无效。当然,你的出版日期应该在研究所

如果做微博热度预测需要用到哪些知识

用户转发微博预测特征的相关知识介绍范文

本文的目录导航:

[标题]探索微博用户转发预测专用证书

[第1章]微博转发预测特征选择介绍

[第2章]用户转发预测特征相关知识介绍

[第3章]用户转发预测的数据预处理

[第4章]转发特征的分析与提取

[第5章]微博用户转发特征选择实验

[第6章]过滤特征子集与包装特征子集的比较

[第7章]微博转发

第二章相关知识

介绍本章主要介绍论文中涉及的理论与技术。首先介绍了特征提取与特征选择对机器学习分类任务的重要性,以微博特征的提取为例,对常见的特征提取方法和技术做了简单说明。然后介绍了常见的三种特征选择算法,同时阐明了各自的计算方式和优缺点。最后概述了因子分解机模型的理论,分析了它在处理稀疏数据的特征组合问题上的优势,阐释了本文选取因子分解机作为微博用户转发预测模型的原因。

2.1 特征

提取在机器学习分类预测任务中,在将学习算法应用于训练样本进行建模,预测未知样本之前,通常需要先对获得的原始数据进行特征提取和选择,然后再训练学习器。特征提取和特征选择是机器学习分类预测中关键的一个环节,其优势主要有:(1)降低了特征的维度,减轻了维数灾难问题,减少了模型的训练时间,提高了学习器的泛化能力,能帮助更高效的建立分类器。(2)能够发现更有意义的潜在特征,帮助提高模型的预测能力。(3)能够决定哪些特征与预测任务相关,帮助更深入的理解模型的预测结果和数据的含义。随着大规模和高维数据的涌现,特征提取和特征选择已成为数据挖掘和机器学习中不可或缺的部分。

在微博数据中,有些数据可以直接作为特征,比如,用户是否认证、发布微博数量等,可以直接转化为数字特征。有些数据需要经过处理之后才可以作为特征,比如两个用户兴趣的相似程度,能够为人直觉感知,但难以定量描述,导致机器无法判别,可以通过特征提取技术将复杂的原始特征数据转化成适合机器学习判别和分析的数字特征,使机器学习分类预测任务能够顺利进行。一般原始特征的维度较高,对于有限的训练样本而言,高维的原始特征与稀疏的样本会导致类别间难以区分,特征提取能够在保证分类准确度的前提下,将原始特征映射为区分性更好的特征,使分类器容易判别,提高分类的准确性。比如微博的文本特征,将初始数据转换为文档在向量空间模型的一个矩阵,通过特征提取将不同的词都映射到低维空间,既保持了原始数据的信息,又可以发现词的内在联系,得到本质的特征。

对有些数据来讲,特征之间可能具有一定的相关性,用特征提取方法可以将原始特征集合中的某些特征进行组合,经构造得到新的特征,或者是将它们进行变换,得到不同的特征,这类特征通常能更有效的识别样本。比如微博作者的关注人数和粉丝人数,一般有影响力用户的粉丝人数比关注人数多很多倍,而普通用户两者差别不大,如果用两者的比例来代表这个特征,既能更好的表示用户的影响力,又降低了特征的维度。

2.2 特征选择

特征选择指在全部的特征集合中选择一个与当前预测任务相关的特征子集,剔除与任务无关或弱相关的冗余特征,使后续学习过程只需要在重要的特征上构建模型[23].尽管冗余特征对某些特征子集有效,但冗余特征会增加数据维度,使样本数据越来越稀疏,导致出现“维数灾难”现象,造成极大的负面影响[24].特征选择一般有三种情况:(1)从初始特征集合中选择一定数量的特征子集,使分类器的预测效果最好。(2)设定模型最低要达到的预测效果,求数量最少的特征子集。(3)在模型的预测效果和特征子集的维度之间进行折中。

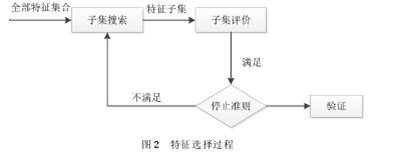

特征选择过程如图2所示,首先使用子集搜索策略产生候选子集,然后利用子集评价方法对候选子集进行评价,如果不满足停止准则,再产生下一个候选子集,再对其进行评价……,如果满足停止准则,则候选子集为选择的特征子集,通常最后还需要对特征选择结果进行验证。

从图中可以看出,特征子集搜索和子集评价是特征选择关键的环节,在没有任何领域知识作为先验假设的前提下进行特征选择,需要遍历所有可能的子集,这在计算上会遭遇严重的组合爆炸问题,特征个数稍多就难以进行,比如,含有n个特征的集合的特征子集个数为2n-1,计算开销极大[23].完全搜索子集难以实现,人们退而求其次,提出了求解较好的次优解的启发式搜索和随机搜索,在可以接受的计算时间内尽可能接近最优解。按照子集评价方法的不同,常见的特征选择方法大致分为三类:过滤式方法(Filter方法)、封装式方法(Wrapper方法)和嵌入式方法(Embedding方法)[25].

过滤式方法的特征选择过程独立于具体的分类器,它通过相关性度量、信息熵、一致性度量和距离度量等评价初始特征对分类的贡献程度,选择与函数更相关的特征。其特征选择过程与后续学习器无关,不用训练学习器,运行效率高。但是该类方法假设特征间相互独立,单独考虑每一个特征的重要性,忽略了特征间的相互作用,经常不能选出最好的特征子集。即使特征间相互独立,两个单独使用效果最好的特征进行组合,也不能保证是最好的组合[26].当冗余特征与类标签具有高度相关性时,过滤式方法难以完全剔除,同时,一些特征单独作用时其类别区分性不高,但作为整体具备很强的区分能力,却被当作冗余剔除[27].

封装式方法使用后续分类器的预测性能作为评价特征子集的准则,通过比较不同子集训练模型的预测性能,选出最优的特征子集。因为是直接针对给定的分类器进行优化,选择最有利于后续分类器预测性能的子集,分类器最终的预测性能会更好。算法的优势在于能够选择更少的特征,同时获得高效的预测效果。但是,该类方法在特征选择的过程中需要多次训练学习器,随着集合的子集数量增加,时间复杂度呈指数级上升,算法效率较低[28].

嵌入式方法将特征选择的过程与分类器训练的过程融为一体,后续学习算法的结果同时也是特征子集评价准则的一部分,在确定学习器的前提下,学习出对提高该学习器性能最好的特征,在学习器训练过程中自动的进行特征选择。因为在使用特征训练学习器的过程中,同时根据学习器的预测结果来选择对学习器的训练有重要意义的特征子集,使得学习器的性能较好,但是,同封装式方法一样,该方法的时间复杂度高,特征选择的效率较低。

2.3 因子分解机

因子分解机(Factorization Machine,FM),是Steffen Rendle提出的一种基于矩阵分解的评分预测模型[29].传统的矩阵分解模型基础扎实,预测精度高,但限制数据输入格式,面对新问题时,需要针对具体应用重新开发和实现学习算法,不具有通用性。

SteffenRendle提出的因子分解机结合了矩阵分解的高预测精度和特征工程的通用性,能工作在任何实值特征向量中,其通过对输入特征的设置,可以模拟大多数分解模型,包括MF、SVD ++、PITF和FPMC等[30].且因子分解机的通用性并没有以低预测精度或高计算复杂度为代价,Steffen Rendle通过实验证明因子分解机的预测精度完全可以和专业模型的最佳推理方法相比[31].

因子分解机最大的特点是在保留的交叉项的权重上面引入了因子分解的概念。以二阶的因子分解机模型为例,模型表示为公式(2.1):

从公式中可以看出,因子分解机模型不仅考虑了每个输入变量的一元交叉iw ,又引入了输入变量的所有成对交叉,且不同于传统分解模型中直接用一个实数i, jw来表示两个特征分量间的交互权重的方式,在因子分解机模型中,使用两个向量的内积,i j

作为交互权重,这两个向量分别表示了两个特征的本质特征,通过这样的方式,两个特征分量间的交互权重由一个实数扩展到了两个向量,因此即使在预测集中遇到了两个从未在训练集中出现的特征交互,这两个特征所对应的向量也能通过训练集中其他的交互得到充分的学习。这个思路同样可以推广到二阶以上的交互特征,学习更多特征分量之间的关系,因此,因子分解机模型能刻画稀疏矩阵中任意特征之间的相互作用,较好的解决了稀疏矩阵下的特征组合问题。

2.4 本章小结

本章首先介绍了特征提取和特征选择在机器学习分类预测中的关键作用,然后以微博特征提取为例,介绍了常见的特征提取方法,接着对常见的三种特征选择算法做了说明,同时阐明了计算方式和优缺点,最后概述了因子分解机模型的理论与公式,阐释了因子分解机在处理特征组合问题上的优势。